最近关于Token的讨论挺魔幻的。朋友圈随处能看到Token中文翻译的讨论——有”词元””智元”等等,甚至有”慧根”之类的搞笑版本。

Token不是一个新概念,大模型落地第一天起,它便与神经网络共生,但直到OpenClaw在用户群大规模扩散,各类Agent应用开始把Token带入了公众视野。

我认为其中有两个关键问题:它的消耗量太大了,价格也太贵了。

记得OpenAI发布GPT-5.4的时候,有用户反馈测试一句”你好”就消耗掉了80美元的Token,当时不少人都说这个使用量太夸张,但随着小龙虾大规模在用户群扩散,一个任务烧完千万级Token成为常态。

与之相对的是,英伟达CEO黄仁勋在GTC2026大会上以及之后的很多场合,都在强调工程师要大量的使用Token,甚至将Token纳入到薪酬激励机制。

一次对话环节,黄仁勋说:”如果年薪50万美元的工程师,连25万美元的Token都没用掉,我会极度恐慌。”

问题是,疯狂的烧Token一定能解决问题吗,有多少Token是有效的,什么样的投入产出比是合理的?

结合刚刚外媒的消息,有OpenAI程序员一周烧掉了2100亿Token,相当于33个维基百科,但这样的消耗量最终带来了什么?

很显然,这场疯狂烧Token的运动,能带来多少效果是存疑的,谁是获利者则是确定的。

存储瓶颈与效率黑洞

Token简单理解就是大语言模型处理信息的基本单位——用户输入提示词,模型输出答案,每一个字、每一个标点,都会计入Token的消耗量,本质上还是算力成本。

过去大家计算算力总拥有成本,指标有很多,包括衡量能效的Flops/W,核算均值的成本/Flops等等,今年的”Token经济学”中,Token/W逐步成为共识。

对于Token降本来说,一个不好的消息是内存价格在疯涨。以HBM内存为例,它是支撑大模型训练和推理的关键器件,同时,推理数据量的暴涨也引发出了存储需求的同步上涨。2026年第一季度,DRAM的价格环比上涨超过50%,NAND价格环比最高涨幅达到150%。

价格战再来

中国大模型的价格战,不是没有先例。2024年,国内厂商就曾经爆发过一轮激烈的价格战。当时恰逢DeepSeek-V2上线,每百万Token输入1元、输出2元,彼时价格相当于GPT-4-Turbo的百分之一。

DeepSeek当时的降价关键就在于推理优化——MoE稀疏架构大幅降低了计算量,MLA多头潜在注意力把KV缓存压缩90%以上。

把模型”焊”在芯片上

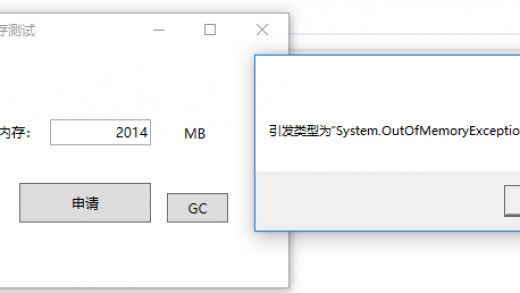

为了解决Token疯狂消耗带来的成本问题,一部分用户开始尝试利用本地部署模型。

2月份,Taalas团队推出了一款全新的芯片HC1,该芯片基于TSMC N6制程,单芯片可运行Llama 3.1 8B模型,最核心的是单用户TPS输出16960/s,数据堪称爆表,关键就在于HC1的设计——用Mask ROM将Llama 3.1 8B模型权重硬编码固化在硅片上,相当于把模型”焊在”芯片上。

一切的讨论都基于Token使用成本——贵的不是单价,而是重度任务对Token使用量的倍数放大。

要改变这一点,要么拥有更便宜的Token定价,要么Token消耗最小化,这依赖模型层面的优化,也取决于推理硬件层面的创新。但无论如何,在Token使用的总费用打不下来,且投入的有效产出不明确的情况下,疯狂安利Token消耗,甚至强调与绩效挂钩,说是制造Token焦虑,制造AI焦虑也不为过。

原文链接:虎嗅